京东健康王国鑫:从封闭到开放,大模型专家推理之路

2024-12-25 10:00:002024年12月12日,由南方周末报社主办的第四届科创大会在北京落下帷幕。大会汇集各方嘉宾共同探讨行业、企业的科创突破,思考如何以新技术撬动新产业、新业态、新模式,驱动社会进步和人类发展。 京东健康智能算法部负责人王国鑫分享了《从封闭到开放,大模型专家推理之路》的主题演讲。 本文将主题演讲辑录如下,有部分删节。 人工智能让大家兴奋的主要原因,就是这项技术的最终极目标是创造一个类似人的智慧体,因此AI大模型能力在很多时候被类比为人的能力。 情感价值与实用价值 大模型的底层能力可以分为交互能力、分析能力、规划能力和决策能力。如果将这四种能力放在“光谱”上,那么越往左边越能满足人类的情感需求,比如Chat GPT中“Chat(聊天)”的由来,与交互能力密不可分。 而在“光谱”的右边,人工智能还是要解决实际问题,包括基于知识、经验所形成的分析,对任务的规划,以及面对不确定信息的决策能力。 从技术发展的角度,我们当然希望有一款模型能够解决上述所有问题。但从技术落地的角度,当前大模型的发展是从一统逐步走向多系统、差异化的趋势。例如,GPT大模型也分为交互型GPT-4o和推理型GPT-o1。 正如《思考,快与慢》一书中设定的假说,人类的思维过程被分为由情感支撑的交互类快速决策,以及深思熟虑的智能化系统,差异化模型天然符合人类的发展历程。 谈到分析、规划和决策,背后的支撑逻辑就是推理。推理能力是大模型解决实际问题的关键,也是业界研究的热点。目前,推理大模型在数学、代码等问题上表现出了卓越的性能,已经超越人类的想象。 如何让一个大模型学会像人类那样思考?本质就是在语言表达基础之上,叠加一个逻辑思考。比如,我们问大模型“从1到1000里面共有几个质数”,它在回答之前做了大量的目标澄清、任务分解、候选方案、自我修正和验证回答。技术路线就是,把人类的思考过程训练到模型之中。 从封闭走向开放 数学、代码等问题都属于封闭领域。一旦走向媒体、法律、医疗、教育等开放领域,大模型推理则面临着一系列困难。 总结来看,主要有四点: 1、知识的复杂性和动态性。知识体系庞大而复杂,并且随着时间推移不断更新和变化。以医疗行业为例,每年都有大量论文发布,不同观点的碰撞,让知识处于动态中。 2、答案的不确定性。相比数学等问题,我们生活中的很多推理问题往往没有唯一答案。 3、推理过程的复杂性。很多开放问题的推理过程比较难以识别,需要大量专家将关键问题进行多步骤、多因素的综合分析和判断,形成较强的推理过程。 4、评估指标的模糊性。由于答案的不确定性,专家或者普通用户都没办法评估大模型的输出是否准确。 因此,大模型的发展路径要回归到“分而治之”,观察人类专家怎样走向专业,包括语言能力、逻辑推理、知识系统、行业安全以及专家经验,进而构建出一个人类专家水平的大模型推理机器,这是我们的初步设想。 开放领域专家推理之路 如何达成初步设想?由于人工智能是数据工作为先、算法工作为后,我们先要创造推理数据,才能让模型学会推理。当大量数据存在于人类知识体系而不是自然场景,大模型发挥推理能力就比较困难。 因此,我们需要寻找与人类专家合作的通道,把人脑的推理过程进行数字化,比如一个法律案例或是患者病例,基于行业经验和规范,通过人机协作方式检索有效知识,进而形成比较长的推理路径,最终给到模型学习。这就是“领域专家推理数据之道”。 接下来,我们应当如何落实?以医疗行业为例,第一,寻找可靠的数据。医疗是一个极其看重临床经验的行业,而很多临床经验并不见诸文字。我们需要把医生和专家的智慧合成文本,形成可靠的医学数据,这一过程绕不开各大技术团队、公司和高校。 第二,循证医学的推理逻辑。很多行业不仅要知其然,还要知其所以然——模型是基于哪些知识,看过哪些症状,根据某个专家共识引用了什么病例才做出的诊断。这就是人类和机器的不同,人类可以通过经验快速做出判断,可是机器还没有获得这样的信任。我们要把“知其然、知其所以然”的判断逻辑呈现给人类专家。 第三,循证实践或临床实践。很多专家领域的模型,都要回答行业知识:是否基于文本?是否容易学习?能否证实推理过程?与业务体系是否可以有机结合?这也是我们当下需要解决的几个核心问题。 人们的乐观情绪总是在波峰与低谷之间波动。比如在一部分无人驾驶原型车问世之前,大家普遍预测无人驾驶在2020年前后(10年左右的时间)能够普及。如今,时间即将来到2025年,最初高歌猛进的愿望其实已经落空。即使如此,我们仍然相信3-5年后甚至更多年后,无人驾驶一定会成为重要的应用方向。 因此,我建议人工智能在无人驾驶领域的应用,可以通过L1-L5分级落地到不同场景,从而有效把握节奏,也希望人工智能技术能够改变行业的未来。

2024年12月12日,由南方周末报社主办的第四届科创大会在北京落下帷幕。大会汇集各方嘉宾共同探讨行业、企业的科创突破,思考如何以新技术撬动新产业、新业态、新模式,驱动社会进步和人类发展。

京东健康智能算法部负责人王国鑫分享了《从封闭到开放,大模型专家推理之路》的主题演讲。

本文将主题演讲辑录如下,有部分删节。

人工智能让大家兴奋的主要原因,就是这项技术的最终极目标是创造一个类似人的智慧体,因此AI大模型能力在很多时候被类比为人的能力。

情感价值与实用价值

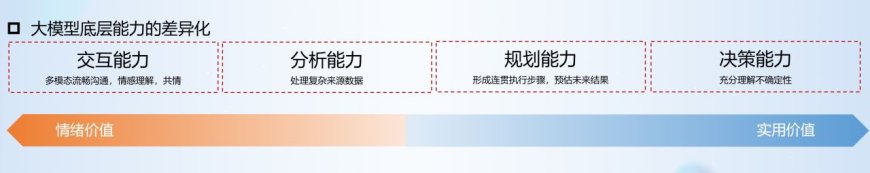

大模型的底层能力可以分为交互能力、分析能力、规划能力和决策能力。如果将这四种能力放在“光谱”上,那么越往左边越能满足人类的情感需求,比如Chat GPT中“Chat(聊天)”的由来,与交互能力密不可分。

而在“光谱”的右边,人工智能还是要解决实际问题,包括基于知识、经验所形成的分析,对任务的规划,以及面对不确定信息的决策能力。

从技术发展的角度,我们当然希望有一款模型能够解决上述所有问题。但从技术落地的角度,当前大模型的发展是从一统逐步走向多系统、差异化的趋势。例如,GPT大模型也分为交互型GPT-4o和推理型GPT-o1。

正如《思考,快与慢》一书中设定的假说,人类的思维过程被分为由情感支撑的交互类快速决策,以及深思熟虑的智能化系统,差异化模型天然符合人类的发展历程。

谈到分析、规划和决策,背后的支撑逻辑就是推理。推理能力是大模型解决实际问题的关键,也是业界研究的热点。目前,推理大模型在数学、代码等问题上表现出了卓越的性能,已经超越人类的想象。

如何让一个大模型学会像人类那样思考?本质就是在语言表达基础之上,叠加一个逻辑思考。比如,我们问大模型“从1到1000里面共有几个质数”,它在回答之前做了大量的目标澄清、任务分解、候选方案、自我修正和验证回答。技术路线就是,把人类的思考过程训练到模型之中。

从封闭走向开放

数学、代码等问题都属于封闭领域。一旦走向媒体、法律、医疗、教育等开放领域,大模型推理则面临着一系列困难。

总结来看,主要有四点:

1、知识的复杂性和动态性。知识体系庞大而复杂,并且随着时间推移不断更新和变化。以医疗行业为例,每年都有大量论文发布,不同观点的碰撞,让知识处于动态中。

2、答案的不确定性。相比数学等问题,我们生活中的很多推理问题往往没有唯一答案。

3、推理过程的复杂性。很多开放问题的推理过程比较难以识别,需要大量专家将关键问题进行多步骤、多因素的综合分析和判断,形成较强的推理过程。

4、评估指标的模糊性。由于答案的不确定性,专家或者普通用户都没办法评估大模型的输出是否准确。

因此,大模型的发展路径要回归到“分而治之”,观察人类专家怎样走向专业,包括语言能力、逻辑推理、知识系统、行业安全以及专家经验,进而构建出一个人类专家水平的大模型推理机器,这是我们的初步设想。

开放领域专家推理之路

如何达成初步设想?由于人工智能是数据工作为先、算法工作为后,我们先要创造推理数据,才能让模型学会推理。当大量数据存在于人类知识体系而不是自然场景,大模型发挥推理能力就比较困难。

因此,我们需要寻找与人类专家合作的通道,把人脑的推理过程进行数字化,比如一个法律案例或是患者病例,基于行业经验和规范,通过人机协作方式检索有效知识,进而形成比较长的推理路径,最终给到模型学习。这就是“领域专家推理数据之道”。

接下来,我们应当如何落实?以医疗行业为例,第一,寻找可靠的数据。医疗是一个极其看重临床经验的行业,而很多临床经验并不见诸文字。我们需要把医生和专家的智慧合成文本,形成可靠的医学数据,这一过程绕不开各大技术团队、公司和高校。

第二,循证医学的推理逻辑。很多行业不仅要知其然,还要知其所以然——模型是基于哪些知识,看过哪些症状,根据某个专家共识引用了什么病例才做出的诊断。这就是人类和机器的不同,人类可以通过经验快速做出判断,可是机器还没有获得这样的信任。我们要把“知其然、知其所以然”的判断逻辑呈现给人类专家。

第三,循证实践或临床实践。很多专家领域的模型,都要回答行业知识:是否基于文本?是否容易学习?能否证实推理过程?与业务体系是否可以有机结合?这也是我们当下需要解决的几个核心问题。

人们的乐观情绪总是在波峰与低谷之间波动。比如在一部分无人驾驶原型车问世之前,大家普遍预测无人驾驶在2020年前后(10年左右的时间)能够普及。如今,时间即将来到2025年,最初高歌猛进的愿望其实已经落空。即使如此,我们仍然相信3-5年后甚至更多年后,无人驾驶一定会成为重要的应用方向。

因此,我建议人工智能在无人驾驶领域的应用,可以通过L1-L5分级落地到不同场景,从而有效把握节奏,也希望人工智能技术能够改变行业的未来。