世界正处于超级人工智能时代

Array自2015年在旧金山成立以来,OpenAI就宣布其主要目标是开发模仿人类智能并造福全人类的安全通用人工智能(AGI),但直到最近才透露何时实现这一目标。 2024年7月,OpenAI谈到将人工智能分为5个等级: 第一级:对话式人工智能 这一等级是指使机器能够理解和处理人类语言,以自然和上下文方式与人类对话,并帮助它们创建自己内容的技术。这包括聊天机器人、虚拟助手和其他旨在通过文本、语音或两者与用户交互的工具。 目前有几个可用的程序属于这个级别,但在目的和使用性质方面有不同程度的差异,包括OpenAI的ChatGPT、亚马逊的Alexa、微软的Copilot、苹果的Siri、谷歌的Gemini、IBM的Watson等。 第二级:推理人工智能 这一等级是指旨在模拟类似于人类的逻辑思维和决策的智能系统。这涉及使用算法来解决问题、得出结论并根据给定的数据和规则做出决策。一些公司最近开始尝试被认为处于该级别早期阶段的技术,例如 Open AI 的“O1”。 第三级:自主人工智能 这一等级是指能够在无需人工干预的情况下自主执行任务和做出决策的系统。这些系统利用自学习、逻辑推理和感知来动态适应和响应环境。这些系统可以充当代表用户的独立代理,例如在度假时工作。 许多公司正在努力达到这一水平,但还没有完全实现。最简单的例子是自动驾驶汽车,当它们达到不需要人工监控其操作的水平时。 第四级:创新人工智能 这一等级是指能够独立探索、创新和开发新想法、产品或解决方案的智能系统。此级别的批判性思维用于非常有效地发展业务和实现目标,达到这一水平代表着人工智能的能力和应用实现了巨大飞跃,使其更接近高级人工智能。 第五级:组织人工智能 最后一个等级是指能够执行整个组织或机构工作的超级智能,即执行组织或机构中每个人的工作,以及所执行的每项功能,这是通过自动化代理协同工作、进行改进并管理所需的一切来完成,而无需人工参与。 组织人工智能不仅限于管理整个组织或机构的工作,还可以通过分析数据并获得支持战略规划和提高业务效率的见解来改进和增强业务流程和决策。 2024 年 9 月,OpenAI 首席执行官萨姆·奥尔特曼(Sam Altman) 表示,在“几千天”内,即几年内,实现在所有领域都超越人类的高级人工智能是可能的。 组织人工智能不仅可以管理整个组织或组织的业务,还可以改进和增强业务流程和决策(盖蒂图像) 2025 年通用人工智能 2024年11月8日,创业孵化器Y Combinator董事长兼首席执行官陈嘉兴(Garry Tan)采访萨姆·奥尔特曼时问道,“2025年你对什么感到兴奋?什么来了?” “通用人工智能。”奥特曼立即回答道,“我对此感到兴奋。” 这现实吗? 2023年3月,GPT-4聊天推出后不久,它就经历了进入美国大学或从事商业活动所需的多项考试,并取得了不错的成绩。在美国大学入学时采用的SAT考试中,循证阅读与写作部分,GPT-4获得了710分(满分800分),也就是说,他的成绩比参加这次测试的 93% 的人都要好。 在数学部分,GPT-4获得了700分(满分800分),比参加这次考试的89%的人都取得了更好的成绩,GPT-4总共获得了 1600 分中的 1410 分,这使其有资格进入所有美国大学,包括精英大学(如哈佛大学和斯坦福大学),这些大学通常要求成绩高于 1400 分。 在医学院入学考试 (MCAT) 中,GPT-4获得了 511 分(满分 528 分),表现优于 80% 的考生,所获得的成绩使其有资格进入最负盛名的大学,要求分数至少为 510 分。 GPT-4在美国统一律师协会 (UBE) 考试中取得了 297 分,该考试使律师有资格从事该职业,这一结果超出了美国所有州成功所需的最低标准,据悉,亚利桑那州的最低及格分数是美国所有州中最高的,达到了273分(满分400分)。 GPT-4的成绩比参加这次考试的百分之九十的人的成绩都要好,这些结果并不意味着其智力水平已经接近人类,因为它仍然有很多弱点,特别是在逻辑(推理)领域,而这正是 OpenAI 在其最近发布的“o1”中试图改进的地方,目前也在大力开发明年版本的逻辑功能。 根据OpenAI确定的五个级别,可以说,符合通用人工智能的级别是第二个等级,即逻辑人工智能。超越此水平(自主、创新和组织人工智能)代表了迈向人工超级智能(ASI)的高级步骤,超越了基本的 AGI 功能。 如果 OpenAI 在 2025 年成功为其产品开发人工智能逻辑能力,那么我们可以说,根据阿兰图灵测试(目前已知),我们已经达到了通用人工智能的基础水平,该测试衡量机器在对话中模拟人类行为的能力,从而使人无法知道自己是在与人交互还是与机器交互。 关于人工智能优于人类危险的警告并不新鲜(盖蒂图像) 世界准备好迎接通用人工智能了吗? 2023 年 10 月,在一次关于人工智能未来的公开讨论中,萨姆·奥尔特曼表示:“如果我们没有建立足够的基础设施,AGI 将只能供少数人使用,这可能会引发战争,并且在很大程度上成为富人手中的工具。” 关于人工智能超越人类危险的警告并不新鲜。已故物理学家史蒂芬·霍金在2014年接受BBC采访时表示:“全面人工智能的发展可能会导致人类的终结。”至于埃隆·马斯克,他认为,这种可能性只有20%,但无论如何我们都必须这么做。 至于2018年获得图灵奖、被认为是人工智能之父之一的加拿大计算机科学家约书亚·本吉奥(Joshua Bengio),他谈到人工智能时说,“我们创造了比我们更强大的怪物。” 联合国秘书长安东尼奥·古特雷斯多次警告使用自动操作智能武器的危险,他说:“用配备自主人工智能的机器瞄准人类是一条不应跨越的道德底线。” Meta本月早些时候宣布,将允许美国国家安全机构和国防承包商使用其开发的开源人工智能模型Llama,这证实了人们对利用人工智能开发自主武器可能性的怀疑。 最后,在2017年讨论人工智能的未来时,弗拉基米尔·普京表示:“谁坐上人工智能的宝座,谁就将统治世界。” 超通用人工智能即将到来,它将使拥有它的人能够做一些迄今为止看来难以想象的事情。除非当前的世界秩序发生变化,否则它可能会爆发战争,并且最终可能落入少数有影响力的团体手中。 来源 : 半岛电视台获取更多RSS:https://feedx.net https://feedx.site

自2015年在旧金山成立以来,OpenAI就宣布其主要目标是开发模仿人类智能并造福全人类的安全通用人工智能(AGI),但直到最近才透露何时实现这一目标。

2024年7月,OpenAI谈到将人工智能分为5个等级:

-

第一级:对话式人工智能

这一等级是指使机器能够理解和处理人类语言,以自然和上下文方式与人类对话,并帮助它们创建自己内容的技术。这包括聊天机器人、虚拟助手和其他旨在通过文本、语音或两者与用户交互的工具。

目前有几个可用的程序属于这个级别,但在目的和使用性质方面有不同程度的差异,包括OpenAI的ChatGPT、亚马逊的Alexa、微软的Copilot、苹果的Siri、谷歌的Gemini、IBM的Watson等。

-

第二级:推理人工智能

这一等级是指旨在模拟类似于人类的逻辑思维和决策的智能系统。这涉及使用算法来解决问题、得出结论并根据给定的数据和规则做出决策。一些公司最近开始尝试被认为处于该级别早期阶段的技术,例如 Open AI 的“O1”。

-

第三级:自主人工智能

这一等级是指能够在无需人工干预的情况下自主执行任务和做出决策的系统。这些系统利用自学习、逻辑推理和感知来动态适应和响应环境。这些系统可以充当代表用户的独立代理,例如在度假时工作。

许多公司正在努力达到这一水平,但还没有完全实现。最简单的例子是自动驾驶汽车,当它们达到不需要人工监控其操作的水平时。

-

第四级:创新人工智能

这一等级是指能够独立探索、创新和开发新想法、产品或解决方案的智能系统。此级别的批判性思维用于非常有效地发展业务和实现目标,达到这一水平代表着人工智能的能力和应用实现了巨大飞跃,使其更接近高级人工智能。

-

第五级:组织人工智能

最后一个等级是指能够执行整个组织或机构工作的超级智能,即执行组织或机构中每个人的工作,以及所执行的每项功能,这是通过自动化代理协同工作、进行改进并管理所需的一切来完成,而无需人工参与。

组织人工智能不仅限于管理整个组织或机构的工作,还可以通过分析数据并获得支持战略规划和提高业务效率的见解来改进和增强业务流程和决策。

2024 年 9 月,OpenAI 首席执行官萨姆·奥尔特曼(Sam Altman) 表示,在“几千天”内,即几年内,实现在所有领域都超越人类的高级人工智能是可能的。

2025 年通用人工智能

2024年11月8日,创业孵化器Y Combinator董事长兼首席执行官陈嘉兴(Garry Tan)采访萨姆·奥尔特曼时问道,“2025年你对什么感到兴奋?什么来了?”

“通用人工智能。”奥特曼立即回答道,“我对此感到兴奋。”

这现实吗?

2023年3月,GPT-4聊天推出后不久,它就经历了进入美国大学或从事商业活动所需的多项考试,并取得了不错的成绩。在美国大学入学时采用的SAT考试中,循证阅读与写作部分,GPT-4获得了710分(满分800分),也就是说,他的成绩比参加这次测试的 93% 的人都要好。

在数学部分,GPT-4获得了700分(满分800分),比参加这次考试的89%的人都取得了更好的成绩,GPT-4总共获得了 1600 分中的 1410 分,这使其有资格进入所有美国大学,包括精英大学(如哈佛大学和斯坦福大学),这些大学通常要求成绩高于 1400 分。

在医学院入学考试 (MCAT) 中,GPT-4获得了 511 分(满分 528 分),表现优于 80% 的考生,所获得的成绩使其有资格进入最负盛名的大学,要求分数至少为 510 分。 GPT-4在美国统一律师协会 (UBE) 考试中取得了 297 分,该考试使律师有资格从事该职业,这一结果超出了美国所有州成功所需的最低标准,据悉,亚利桑那州的最低及格分数是美国所有州中最高的,达到了273分(满分400分)。

GPT-4的成绩比参加这次考试的百分之九十的人的成绩都要好,这些结果并不意味着其智力水平已经接近人类,因为它仍然有很多弱点,特别是在逻辑(推理)领域,而这正是 OpenAI 在其最近发布的“o1”中试图改进的地方,目前也在大力开发明年版本的逻辑功能。

根据OpenAI确定的五个级别,可以说,符合通用人工智能的级别是第二个等级,即逻辑人工智能。超越此水平(自主、创新和组织人工智能)代表了迈向人工超级智能(ASI)的高级步骤,超越了基本的 AGI 功能。

如果 OpenAI 在 2025 年成功为其产品开发人工智能逻辑能力,那么我们可以说,根据阿兰图灵测试(目前已知),我们已经达到了通用人工智能的基础水平,该测试衡量机器在对话中模拟人类行为的能力,从而使人无法知道自己是在与人交互还是与机器交互。

世界准备好迎接通用人工智能了吗?

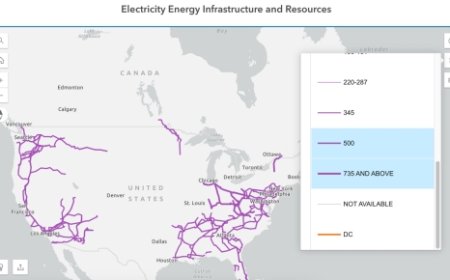

2023 年 10 月,在一次关于人工智能未来的公开讨论中,萨姆·奥尔特曼表示:“如果我们没有建立足够的基础设施,AGI 将只能供少数人使用,这可能会引发战争,并且在很大程度上成为富人手中的工具。”

关于人工智能超越人类危险的警告并不新鲜。已故物理学家史蒂芬·霍金在2014年接受BBC采访时表示:“全面人工智能的发展可能会导致人类的终结。”至于埃隆·马斯克,他认为,这种可能性只有20%,但无论如何我们都必须这么做。

至于2018年获得图灵奖、被认为是人工智能之父之一的加拿大计算机科学家约书亚·本吉奥(Joshua Bengio),他谈到人工智能时说,“我们创造了比我们更强大的怪物。”

联合国秘书长安东尼奥·古特雷斯多次警告使用自动操作智能武器的危险,他说:“用配备自主人工智能的机器瞄准人类是一条不应跨越的道德底线。”

Meta本月早些时候宣布,将允许美国国家安全机构和国防承包商使用其开发的开源人工智能模型Llama,这证实了人们对利用人工智能开发自主武器可能性的怀疑。

最后,在2017年讨论人工智能的未来时,弗拉基米尔·普京表示:“谁坐上人工智能的宝座,谁就将统治世界。”

超通用人工智能即将到来,它将使拥有它的人能够做一些迄今为止看来难以想象的事情。除非当前的世界秩序发生变化,否则它可能会爆发战争,并且最终可能落入少数有影响力的团体手中。